AMD anunció un nuevo acelerador Instinto MI350P en forma de tarjeta PCIe clásica. Se trata de una novedad importante en la oferta de la empresa, ya que el fabricante vuelve a este tipo de construcciones tras un largo parón. El equipo ha sido preparado para empresas que quieran ejecutar inteligencia artificial localmentepero sin la costosa reconstrucción de toda la infraestructura del servidor.

El precio sugerido es un secreto. Hablamos de una solución B2B

El equipo descrito tiene diseño de dos ranuras con una longitud de 267 milímetros y fue diseñado para trabajar en servidores clásicos refrigerados por aire. Para muchas empresas este puede ser el caso. solución intermedia entre el uso de la nube y la inversión en plataformas especializadas, que a menudo requieren cambios importantes en términos de suministro de energía, refrigeración y organización del espacio en el centro de datos y, por lo tanto, son muy costosos.

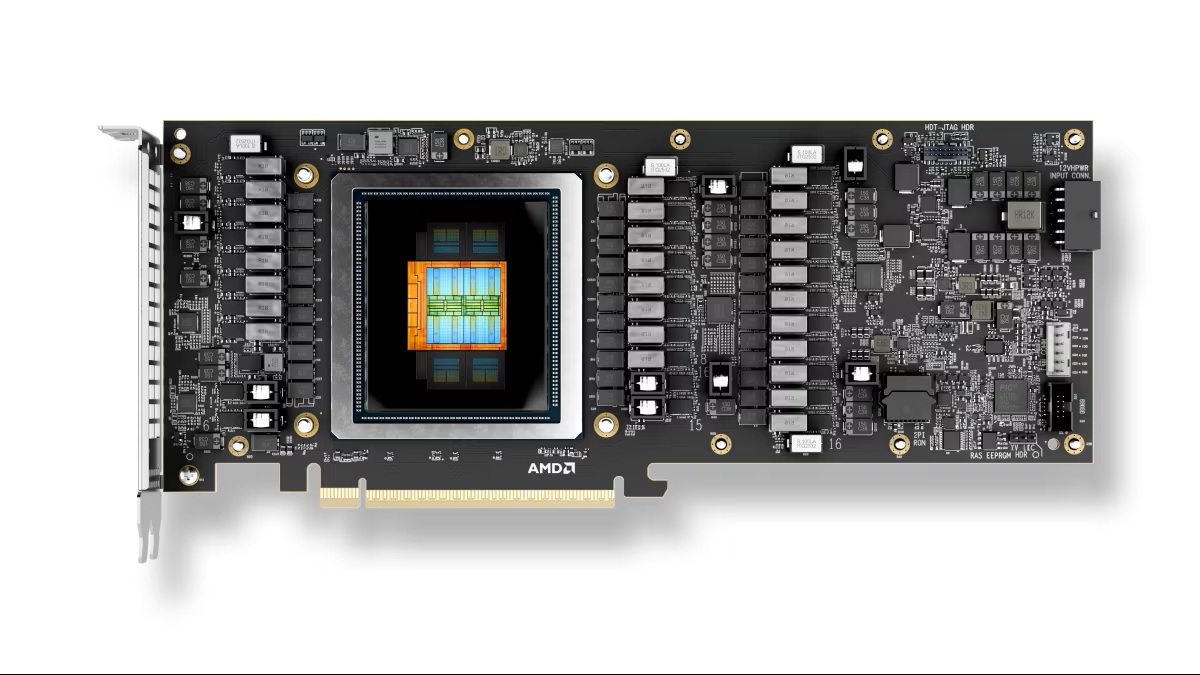

La energía se suministra a través de un solo Conector 12VHPWR (16 pines)debido a TDP de 600W. Sin embargo, nada le impide reducir el consumo de energía a 450 W por su cuenta. «ligera caída en el rendimiento».

AMD Instinct MI350P ofrecerá 2299 TFLOPS para cálculos de FP16 y hasta 4600 TFLOPS usando el formato MXFP4. El fabricante describe esto como el mayor rendimiento disponible actualmente en un acelerador de IA empresarial de esta forma. También estaba a bordo 144 GB de memoria HBM3E con ancho de banda de hasta 4 TB/s.

Los Rojos también mencionan la compatibilidad con la escasez de formatos populares de 8 y 16 bits, así como la compatibilidad con FP8, MXFP8 y MXFP4. En la práctica, esto pretende permitir un uso más eficiente de la potencia informática, reduciendo los requisitos de memoria y reduciendo los requisitos de energía y refrigeración.

AMD también enfatiza ecosistema abierto. Instinct MI350P está diseñado para funcionar, entre otros, con Kubernetes GPU Operador, AMD Inference Microservices y marcos de IA populares, incluido PyTorch. La empresa también proporciona una pila de software de referencia abierta a los socios sin derechos de licencia. Esto tiene como objetivo facilitar la migración de cargas de trabajo de inferencia sin cambios importantes en el código y permitir a las empresas evitar los costos continuos del uso de modelos en la nube.